Лабораторията за изкуствен интелект в Шанхай има MemVerse с отворен код, първата универсална мултимодална памет за агенти на AI, преодолявайки ограниченията на „изолацията на модалността и бавната реакция“ на традиционните системи. За първи път агентите придобиват кръстосана модална памет в изображения, аудио и видео, постигайки „развиваема, интернализируема реакция от второ ниво“ памет за цял живот.

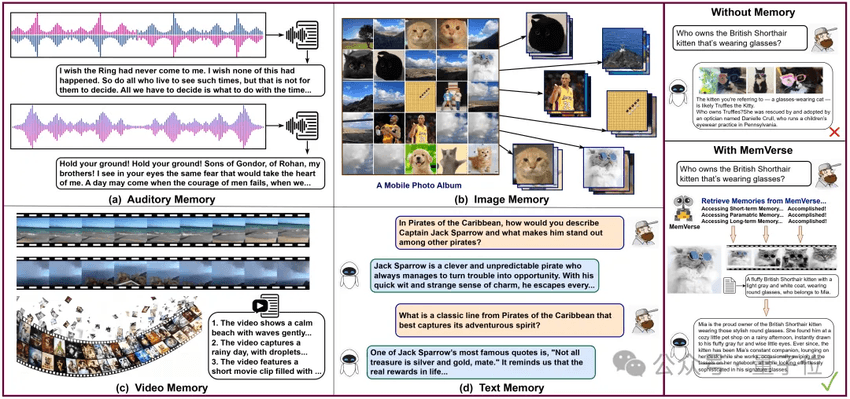

Конвенционалната AI памет е предимно базирана на текст, разчитайки на механично извличане без разбиране на пространствено-времева логика или крос-модална семантика. MemVerse използва трислойна бионична архитектура: централен координатор действа като „префронтален кортекс“ за активно планиране; краткосрочната памет използва плъзгащи се прозорци за кохерентност на разговора; дългосрочната памет изгражда мултимодални графики на знания, категоризирайки основната памет (потребителски профили), епизодичната памет (времеви линии на събития) и семантичната памет (абстрактни понятия), фундаментално смекчавайки халюцинациите.

Пионерска техника за „параметризирана дестилация“ периодично фино настройва високостойностни дългосрочни знания в специални малки модели, повишавайки скоростта на извличане над 10 пъти.

Бенчмарковете показват силни резултати: На ScienceQA GPT-4o-mini с MemVerse скочи от 76.82 на 85.48; MSR-VTT text-to-video R@1 достигна 90,4%, далеч надминавайки CLIP (29,7%) и специалния голям модел ExCae (67,7%). Компресията на паметта и дестилацията намаляват използването на токени с 90%, балансирайки точността и цената. MemVerse вече е с напълно отворен код:

Източник: Liangziwei

Source link

Like this:

Like Loading…

Нашия източник е Българо-Китайска Търговско-промишлена палaта